『日経研月報』特集より

人工知能(AI)研究開発の潮流と展望

2025年6-7月号

1. AI研究開発の3つの潮流

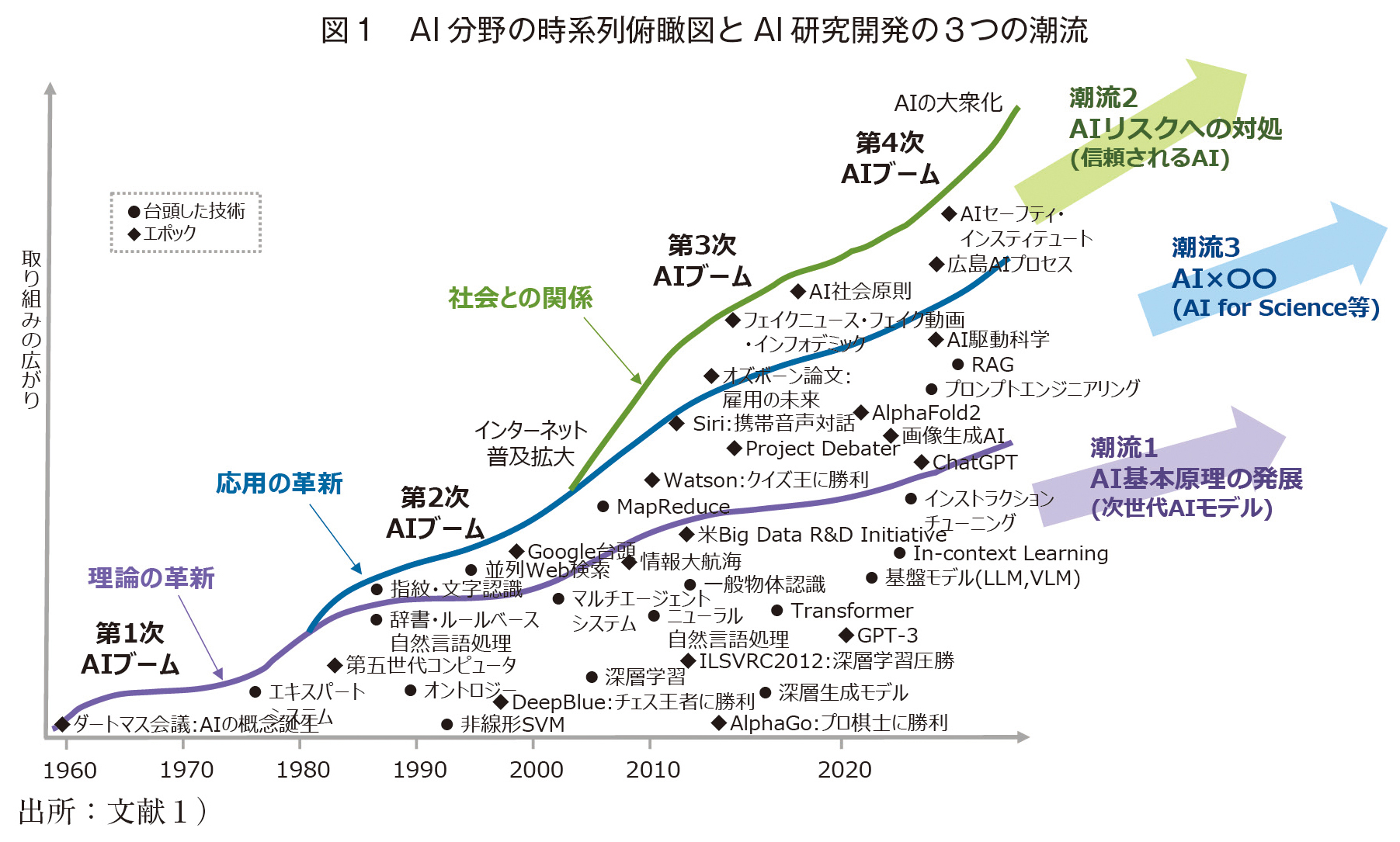

近年、人工知能(以下、AI)技術がめざましい発展を遂げている。図1にAI分野の時系列俯瞰図(文献1))を示した。AIはこれまで、複数回のブームと冬の時代を経ながら発展してきた。

第1次ブームでは、AIの基礎的概念が提案され、新しい学問分野として立ち上がったが、探索問題が中心で、トイシステムに留まった。第2次ブームでは、人手で辞書・ルールを構築・活用するアプローチが主流となり、エキスパートシステム、指紋・文字認識、カナ漢字変換等の実用化に結び付いた。しかし、人手依存の限界から冬の時代を迎えた。第3次ブームでは、インターネットや計算パワーの拡大を背景として、ビッグデータ化と機械学習の発展が牽引し、画像認識、音声認識、機械翻訳、囲碁・将棋等で人間に追い付き/上回る性能を示し、さまざまなAI応用システムが実用化された。

それまでのAIは目的特化型であったのに対して、ChatGPTの登場以降、基盤モデルに基づく生成AIが、高い精度・汎用性・マルチモーダル性を示すようになった。自然言語による対話型インタフェースを備えたことで、「AIの大衆化」といわれるほど利用者の裾野が拡大した。第3次ブームから冬の時代を経ることなく、第4次ブームに移行したといってよいであろう。

ここからさらなる発展につながるAI研究開発の方向性として、図1に示す3つ潮流に着目する(文献1))。第1の潮流は「AI基本原理の発展」である。これまでも、探索、ルールベース、機械学習、生成AIといった形で、基本原理(理論)の革新が新たなAIブームを牽引してきた。第2の潮流は「AIリスクへの対処」である。第3次ブーム以降、AI技術は、広く普及して社会との関係が強まったことで、精度・性能だけでなく、信頼性・安全性等といった社会からの要請を満たすことが、強く求められるようになった。第3の潮流は「AI×〇〇」(さまざまな分野とAIの掛け合わせ)である。AI活用による自動化・効率化に留まらず、産業・社会・科学等の変革がもたらされつつある。

2. 基盤モデル・生成AI

2.1 生成AIの概要

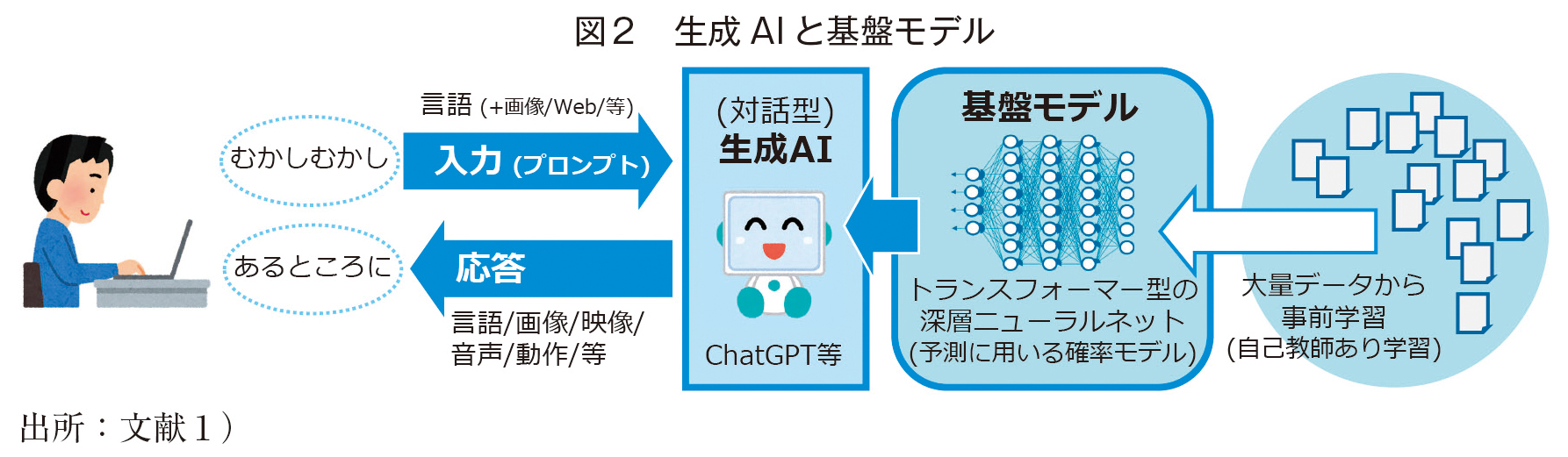

現在の第4次AIブームに着火したのは、ChatGPTに代表される対話型の生成AIである。これは、与えられた入力の続きを確率モデルに基づいて予測することで、応答を生成する。「高度なオートコンプリート機能のようなもの」と例えられることもある。確率モデルとして、膨大なデータからつながり関係を事前学習した深層ニューラルネットを用いており(図2)、これは「基盤モデル」や大規模言語モデル(LLM)と呼ばれる。現在主流のトランスフォーマー型の深層ニューラルネットでは、幅広いコンテキスト情報を参照しつつ、アテンション機構によって、予測のために注目すべき箇所を適切に選択できるようになり、予測精度が大幅に向上した。

第3次ブーム時に主に用いられていた教師あり学習では、入力に対する正解出力(教師データ)を人手で作成する必要があり、その負荷がボトルネックだった。しかし、生成AIでは、自己教師あり学習が開発され、超大規模の事前学習が可能になった。例えば、文章の続きを予測するための学習には、文章の一部を隠して、隠された部分を推定する穴埋め問題型の自己教師あり学習法が使われる。例えるならば、「世界中のテキストをもとに、自分で穴埋め問題を作って、解く練習をひたすらしたら、聞かれたことに対して、たいてい続きを言えるようになった」ようなものと言えるかもしれない。隠された部分の正解は分かっているので、人手で正解を用意する必要がない。基盤モデルの学習は、大規模化するほど精度が向上するというスケーリング則(文献2))が知られるようになり、大規模化が急速に進むことになった。

2.2 基盤モデル・生成AI の取組課題の全体像

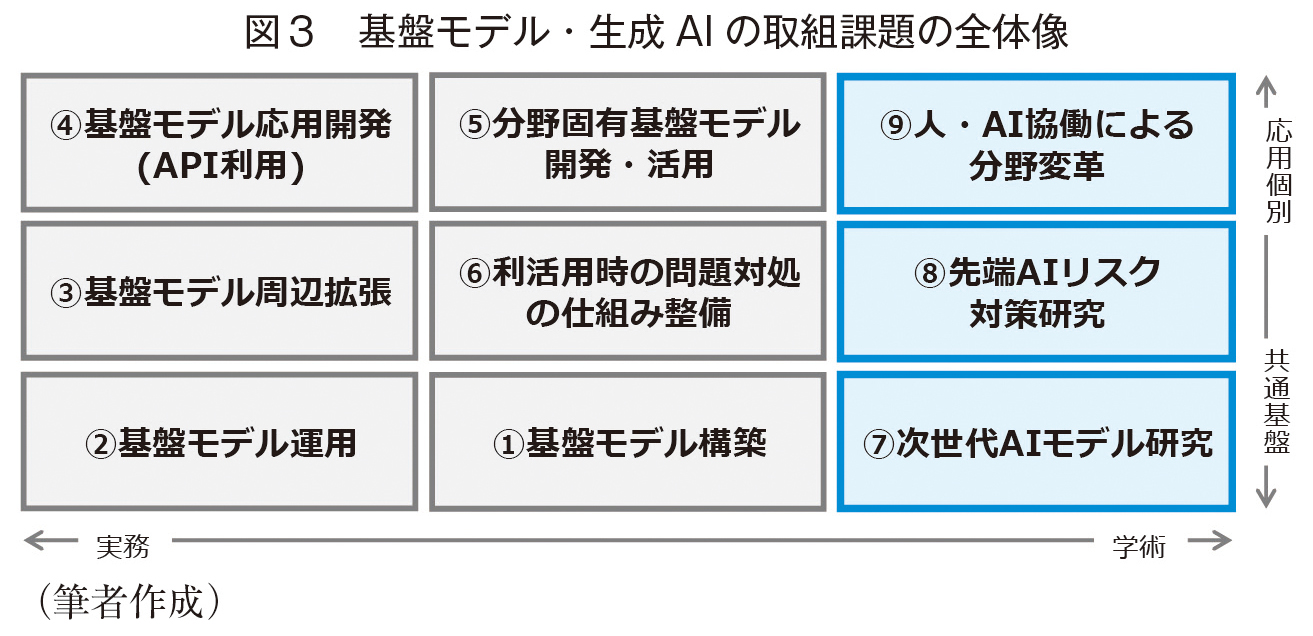

現在の第4次ブームの中心にあるのは、基盤モデルに基づく生成AIである。高い精度・汎用性・マルチモーダル性を実現し、極めて自然な対話応答や専門的な知識・能力を備えているかのような応答を返す。基盤モデルを構築し、さまざまな用途に生成AIを活用するための取組みが急速に広がっている。その取組みの種類を整理し、9つの取組課題から成る全体像(文献1))を図3に示した。

①基盤モデル構築は、大規模化とマルチモーダル化が進む基盤モデルの実装、そのための計算機環境の構築や、データ収集・選別・整備等である。

②基盤モデル運用は、モデルの追加学習・更新がベースとなるが、運用の継続性やトラストの確保も含む。

③基盤モデル周辺拡張は、基盤モデル自体が不得手な機能を外部連携で補ったり、ワークフローを自動設計・最適化したりするものである。

④基盤モデル応用開発(API利用)は、既存の基盤モデルをそのまま利用した応用開発である。

⑤分野固有基盤モデル開発・活用は、基盤モデルを分野固有のデータを用いてファインチューニングしたり、分野固有のモデルを作ったりして分野用途向けシステムを開発するものである。

⑥利活用時の問題対処の仕組み整備は、学習データや出力結果の著作権・肖像権の問題、生成AIの出力物か/人手作成物かの区別等に対処するものである。

⑦次世代AIモデル研究は、現在の基盤モデル・生成AIの限界を克服し、さらに発展させるための基本原理・アーキテクチャの基礎研究である。

⑧先端AIリスク対策研究は、最先端あるいは次世代のAIモデルで生じる人間・社会との不整合リスクへの対策技術の基礎研究である。

⑨人・AI協働による分野変革は、人が担っていたタスクを生成AIで自動化・効率化する面が強かった④⑤に対して、人とAIの協働によって分野の在り方や考え方まで変革するような取組みである。

2.3 開発状況

急速に大規模化が進み、最先端モデルの規模は1兆パラメータを超えている。その1回の学習実行に要する計算費用は100億円超にも及ぶといわれる(文献3))。大規模投資が必要なため、最先端モデルは、OpenAI社のGPT、Google社のGemini、Anthropic社のClaude、Meta社のLlama等、米国ビッグテック企業によって開発されている。次いで中国企業が追い上げており、Baidu社のErnie、Alibaba社のQwen、DeepSeek社のDeepSeek他、多数参入している。

そのような大規模学習に加えて、応答時に時間をかけて多段推論を行うことで、論理推論能力を大きく高めた「推論強化モデル」が2024年後半に登場した。OpenAI o1/o3が先導し、Gemini Thinking、DeepSeek-R1等の後続モデルが投入されている。それぞれ得意分野を持った専門家モデルを束ねたMixture of Expertsの仕組みも活用されている。OpenAI o1は、物理学、生物学、化学の問題でPhDレベル、米国数学オリンピック予選の問題で上位500人に相当する成績を収めたと報告されている(文献4))。

「マルチモーダル基盤モデル」は、対話的な画像生成・動画生成の高品質化だけでなく、利用者とマルチモーダルなやり取りが可能になってきた。例えば、ChatGPT Advanced Voice with Videoでは、スマートフォンのカメラ、マイク、スピーカーを通して、利用者と対面しつつ、利用者が注視する対象物やシーンを共有しながら、音声による会話や音声やジェスチャーによる指示・操作が可能である。

「オープンソース基盤モデル」の性能も高まっている。OpenAI社やGoogle社の最先端モデルの詳細は非公開だが、Meta社のLlamaはオープンソースモデルとして広く活用されている。推論強化モデルでは、DeepSeek-R1がオープンソースモデルとして公開された。

日本の国産基盤モデル開発(文献1))は出遅れたが、2023年以降、参入が相次いでいる。産業界では、中規模で日本語学習を強化したモデルや、組織や用途にカスタマイズしたモデルが多く開発・提供されている。1大学研究室や1企業では難しい規模の投資が必要なことから、経済産業省の「GENIACプロジェクト」をはじめ国による支援が国産モデル開発を後押ししている。国立情報学研究所を中核拠点として大学・企業が多数結集した「LLM-jpプロジェクト」も特記すべき取組みである。

3. 生成AIが3つの潮流にもたらした変化

2.2で基盤モデル・生成AIの取組課題を9つ挙げたが、課題①~⑥は、既にビジネス展開も含めたさまざまな取組みや国による推進策が実行されており、走りながら対応していくべき課題といえる。一方、課題⑦⑧⑨は基礎研究課題であり、本稿の冒頭で挙げた3つの潮流に対応する(⑦が第1、⑧が第2、⑨が第3の潮流に対応)。以降で詳しく説明する。

3.1 第1の潮流「AI基本原理の発展」:生成AIの限界克服へ

基盤モデル・生成AIは非常に高い性能を示しているが、大規模学習で作られた確率モデルに基づいて、入力文の続きを予測することを基本原理としていることから、以下のような点に限界がある(文献1),5))。

・資源効率:極めて大規模なリソース(データ、計算機、電力等)が必要

・実世界操作(身体性):動的・個別的な実世界状況に適応した操作・行動が苦手

・論理性・正確性:厳密な論理操作が苦手で、もっともらしい説明で嘘を出力するハルシネーションを起こす

・信頼性・安全性:ブラックボックスに思え、動作や精度の完全保証はできない

AI基本原理の発展では、これらの限界を克服する次世代AIモデルを目指すことが重要な方向性になる。これにつながる技術開発事例をいくつか挙げる(文献1),5))。

2.3で言及した推論強化モデルは論理性の強化に有効である。また、外部知識を連携させる検索拡張生成(RAG)は、正確性の向上に一定の効果がある。

実世界操作(身体性)については、実世界操作まで含めて学習するロボット基盤モデルの研究開発が活発化している(文献6))。Google社を中心としたロボット基盤モデル構築プロジェクトRX-1/2/Xや、Figure社のFigure 01やPhysical Intelligence社のπ0等のロボット基盤モデルを組み込んだロボット実機での実演が話題になっている。

資源効率は特に難問である。よりコンパクトな基盤モデルの作り方として、大規模モデルのコンパクト化や複数モデルのマージ等があるが、ボトムアップな基盤モデル構築法では省資源化に限界がある。人間の脳は20ワット程度で動いており、そのメカニズムから示唆される点もあるだろう。即応型のシステム1と熟考型のシステム2から成るという二重過程理論や、予測と実際の差異からモデルを修正する能動的推論によれば、より詳細に学習すべき範囲をトップダウンに絞ることで、資源効率を高めることが可能になると思われる。

信頼性・安全性については3.2で関連事例を紹介する。

3.2 第2の潮流「AIリスクへの対処」:AI倫理からAI安全へ

AIの信頼性・安全性に関する不安やリスクは、第3次ブームでAI応用が社会に広がった頃から盛んに論じられている。2019年に日本政府が「人間中心のAI社会原則」を発表し、「OECD AI原則」には42カ国が署名した。深層学習はブラックボックス的で、判定結果の理由が説明されないといった説明性・透明性の問題、学習データの偏り(バイアス)が差別的な判定結果を生むという公平性の問題、個人の行動履歴・嗜好データに関わるプライバシーの問題等があるため、AIに倫理性が求められた。

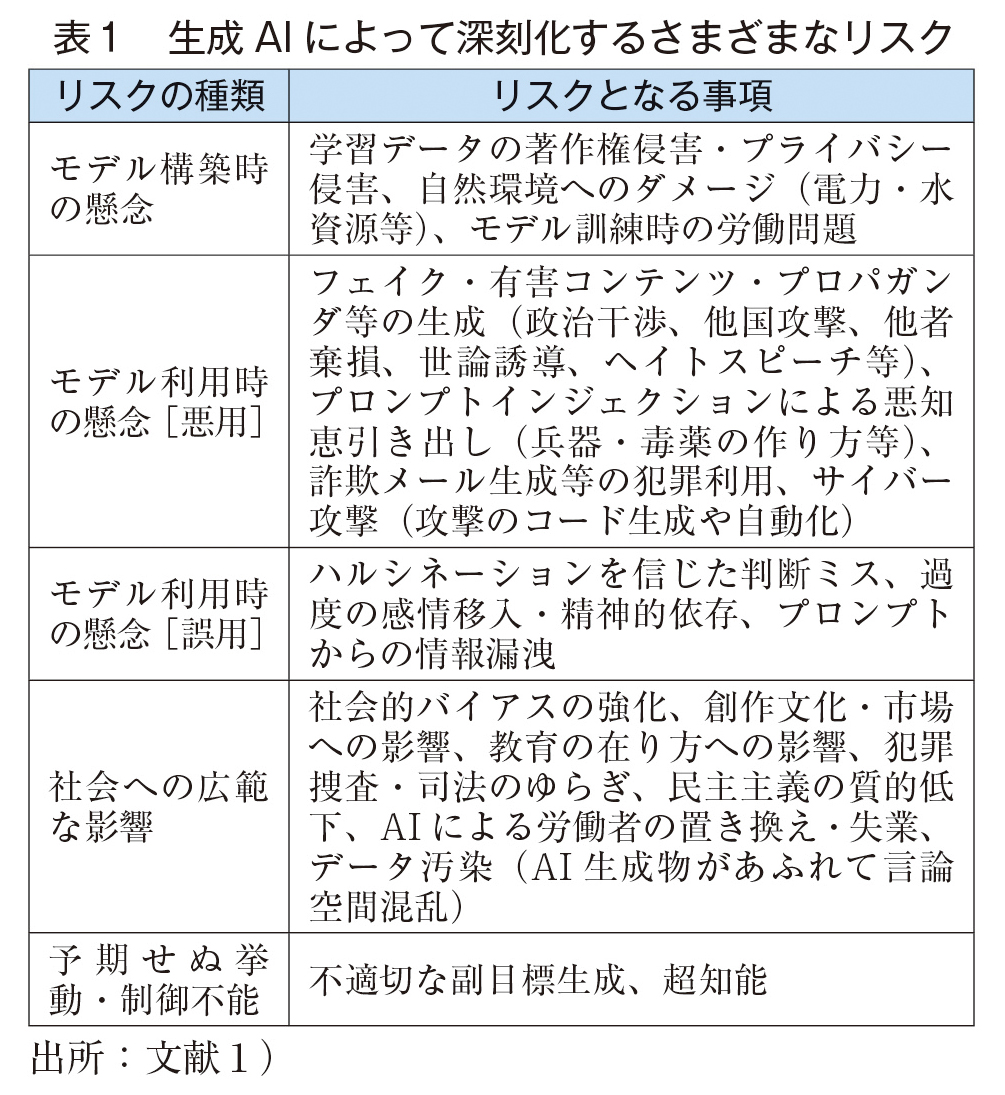

2022年に登場した生成AIは、人間と区別困難な応答を返すことから、偽誤情報の生成・拡散による世論誘導や犯罪の巧妙化といった悪用の問題、自律性が高まったAIが制御不能になる恐れ、社会に対する広範な影響等を含め、さまざまなAIリスクをもたらした(表1)。AIの安全面の懸念が増大したことで、2023年に英国主催で「AI安全サミット」が開催されたのを契機に、英米日他で「AIセーフティ・インスティテュート」が設立された。

AIの倫理性確保には、開発者・事業者に適正な取組みを促すことが重要で、AIの説明性・透明性・公平性の確保やプライバシー保護のための開発ガイドライン作りや技術整備が進められてきた。しかし、AIの安全面の確保には、AI特有の脆弱性を突いて誤動作させたり情報搾取したりする攻撃、生成AIを悪用して人をだましたり誘導したりする攻撃、安全なAIだけでなく邪悪・粗悪なAIが潜み利用者を欺くリスク等にも備えねばならない。そのような攻撃・悪用を見破って防御するAIセキュリティ技術への取組みが進められている。

3.3 第3の潮流「AI×〇〇」:AIは道具からパートナーへ

第3次ブーム時のAIは目的特化型の道具だった。それに対して、生成AIは汎用性が高く、人間と自然言語によるインタラクションが可能なので、その役割は、道具に留まらず、助手や仕事のパートナーに近いものになりつつある。

そのような技術開発事例として、「AIエージェント」が注目されている。生成AIは入力に対する応答を返すものだが、AIエージェントは指示を達成するための手順を立案して実行する。例えば、OpenAI社やGoogle社のDeepResearchは、与えられた話題について、Web検索を実行して、その結果を要約・分析・集約等をして、分析レポートを出力する。Sakana AI社のAIサイエンティストは、研究のアイデア創出、実験の実行、結果の要約、論文の執筆、査読といった科学研究のサイクルを自動的に遂行する。このようなAIエージェントと人間はどのように役割分担して協働するかを考えていく必要がある。

4. 人・AI共生社会へ

オープンソース生成AIやカスタマイズされた生成AIが活用され、AIエージェントが一人ひとりのパートナーのような役割を担っていくならば、多様で多数のAIが社会にあふれるようになる。3.3で述べたように、問題解決・目的達成のために複数のAIが連携して動く事例も生まれている。ビジネス上の取引や交渉をAI同士が実行する試みも始まっており、Gartner社によると(文献8))、マシンカスタマーは2028年までに150億個に達し、2030年までに数兆ドル規模の収益の源泉になるという。

その先の社会展望として、多様な人々と多様なAIが共生・協働して、さまざまな社会課題を解決し、社会システムを全体最適化し、社会の持続・安全性を確保できるようになると期待される。その一方、高度化したAI群によって引き起こされるAIリスク(例えば、人間疎外、暴走・フラッシュクラッシュ、AI談合、思考誘導・依存等)はさらに複雑化・深刻化するかもしれない。

これからのAIの発展は、単体AIの精度・性能を高める研究開発だけでなく、どのような「人・AI共生社会」を実現したいか、在りたい社会の姿を描き、その期待をかなえ、懸念を回避するための研究開発が重要になる。

参考文献

1)科学技術振興機構 研究開発戦略センター,「人工知能研究の新潮流2025 ~基盤モデル・生成AIのインパクトと課題~」,CRDS-FY2024-RR-07(2025年3月).

https://www.jst.go.jp/crds/report/CRDS-FY2024-RR-07.html

2)Jared Kaplan, et al., “Scaling Laws for Neural Language Models”, arXiv:2001.08361 (January 2020).

https://doi.org/10.48550/arXiv.2001.08361

3)Stanford University Human-Centered Artificial Intelligence, “Artificial Intelligence Index Report 2025” (April 2025).

https://hai.stanford.edu/ai-index/2025-ai-index-report

4)OpenAI, “Learning to Reason with LLMs” (September 12, 2024).

https://openai.com/index/learning-to-reason-with-llms/

5)科学技術振興機構 研究開発戦略センター,「戦略プロポーザル:次世代AIモデルの研究開発」,CRDS-FY2023-SP-03(2024年3月).

https://www.jst.go.jp/crds/report/CRDS-FY2023-SP-03.html

6)科学技術振興機構 研究開発戦略センター,「科学技術未来戦略ワークショップ報告書:フィジカルAIシステム」,CRDS-FY2024-WR-07(2025年3月).

https://www.jst.go.jp/crds/report/CRDS-FY2024-WR-07.html

7)科学技術振興機構 研究開発戦略センター,「俯瞰セミナー&ワークショップ報告書:人・AI共生社会のための基盤技術」,CRDS-FY2024-WR-08(2025年3月).

https://www.jst.go.jp/crds/report/CRDS-FY2024-WR-08.html

8)Gartner, 「Gartner、2024年の戦略的テクノロジのトップ・トレンドを発表」,プレスリリース(2023年11月14日).

https://www.gartner.co.jp/ja/newsroom/press-releases/pr-20231114-techtrends

AI・デジタル化

AI・デジタル化